Tempo di lettura:

8–12 minuti

Introduzione

Questo articolo è firmato da Caterina Banella, Advisor in comunicazione strategica e sostenibilità, brand valuecommunications, Consigliere Nazionale FERPI, Ambassador Global Women in PR.

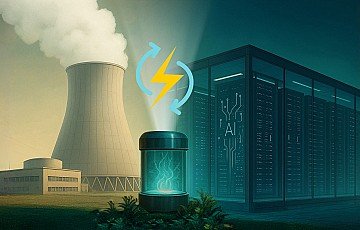

L’AI consuma troppo per essere neutra. Ma può diventare utile, se scegliamo di governarla. L’intelligenza artificiale è oggi più una centrale elettrica che un algoritmo: consuma energia e acqua come nessun’altra tecnologia digitale prima d’ora, e la promessa di “salvare il mondo” rischia di trasformarsi nel suo opposto se non si introducono regole, metriche e accountability. Questa guida riprende e amplia l’analisi pubblicata su HuffPost Italia, traducendola in chiave operativa per imprese, comunicatori e decisori pubblici.

Cos’è la licenza sociale ad operare applicata all’AI?

La licenza sociale ad operare è il consenso non scritto che la collettività concede a un settore o a una tecnologia in cambio di benefici tangibili e responsabilità verificabili. Applicata all’AI, significa che senza utilità sociale dimostrata nessuna tecnologia ha diritto a consumare risorse in modo indiscriminato.

Il concetto è familiare a settori come energia, estrattivo, chimica e farmaceutica, ma è raramente applicato al digitale. È stato Satya Nadella, CEO di Microsoft, a sollevarlo esplicitamente per l’AI, dichiarando che l’intelligenza artificiale deve dimostrare un’utilità sociale tangibile per giustificare il suo costo ambientale.

La rivoluzione digitale non è neutra. Senza benefici concreti e misurabili per la collettività, l’AI rischia di diventare un acceleratore di disuguaglianze sociali e crisi ambientali: automazione senza regole, crescita senza limiti, estrazione di valore senza redistribuzione.

Quanto consumano davvero AI e data center?

I data center consumano oggi circa 415 TWh all’anno e l’AI ne assorbe fino al 20%; secondo l’Agenzia Internazionale dell’Energia (IEA) entro il 2030 si potrebbe arrivare a 1.500 TWh/anno, l’equivalente dell’intero fabbisogno elettrico dell’India.

Ordini di grandezza utili per dimensionare il problema:

- Training di GPT-3: stimato in oltre 550 tonnellate di CO₂, pari a circa 123 auto in un anno.

- Acqua di raffreddamento: un singolo grande data center può consumarne quanto un intero quartiere.

- Google – report di sostenibilità: emissioni cresciute dell’11% in un anno fino a 11,5 milioni di tonnellate di CO₂ (15 milioni considerando le specifiche in appendice).

- Microsoft e Meta: data center energivori alimentati anche da gas fossile, in tensione con i target net-zero dichiarati.

Nota redazionale: i dati provengono da fonti pubbliche (IEA, report di sostenibilità delle big tech, stime accademiche su GPT-3) e vanno aggiornati al momento della pubblicazione.

Cos’è il cyber greenwashing?

Il cyber greenwashing è una forma di greenwashing applicata al digitale: consiste nel comunicare la sostenibilità delle proprie tecnologie – AI, cloud, data center – senza fornire dati verificabili sul reale consumo di energia, acqua e materiali, oppure usando metriche parziali o ambigue.

Non è solo un problema reputazionale. È una nuova forma, più pericolosa, perché si appoggia su un settore percepito come immateriale e quindi “pulito”, mentre dietro ogni prompt c’è hardware fisico, energia, raffreddamento, rifiuti elettronici e supply chain mineraria.

Segnali tipici di cyber greenwashing:

- Claim generici come “AI alimentata da energie rinnovabili” senza dati per data center, regione e ora.

- Assenza di metriche per modello (energia, acqua, watt per token, carbon intensity).

- Compensazioni opache (offset di bassa qualità) usate come scorciatoia narrativa.

- Mancata distinzione tra Scope 1, 2 e 3 nelle emissioni.

- Selezione strategica del perimetro: si rendiconta solo ciò che conviene.

Può l’AI aiutarci a ridurre davvero le emissioni?

Sì, l’AI ha un potenziale tangibile di riduzione delle emissioni in più settori, ma solo se applicata con regole chiare, dati misurabili e governance pubblica – non solo come vetrina di innovazione.

Aree dove l’AI può contribuire in modo significativo:

- Reti energetiche e manutenzione predittiva: ottimizzazione dei carichi, riduzione delle perdite, anticipazione dei guasti; stime indicano fino al -5% di emissioni globali in scenari favorevoli.

- Agricoltura di precisione: meno acqua, meno fertilizzanti e pesticidi, raccolti ottimizzati.

- Mobilità urbana e logistica sostenibile: pianificazione intelligente di flotte, traffico, ultimo miglio.

- Politiche ambientali: previsione climatica avanzata, monitoraggio satellitare, gestione delle risorse naturali.

- Sanità e prevenzione: diagnosi precoci e ottimizzazione dei percorsi terapeutici, con benefici sociali misurabili.

Il problema non è se l’AI può aiutare. È se vogliamo metterla alla prova davvero, invece di limitarla a casi vetrina.

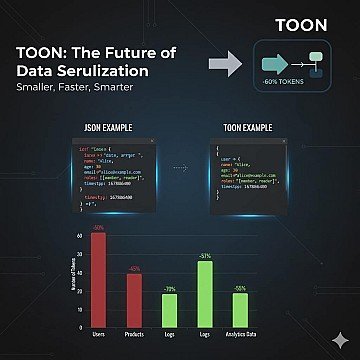

Cos’è il watt per token e perché è una metrica chiave?

Il watt per token misura quanta energia viene consumata dal modello AI per produrre una singola unità di output (token). È una metrica semplice, brutale e impossibile da ignorare: rende il consumo dell’AI confrontabile, comprensibile e rendicontabile.

Un esempio interessante in questo senso arriva da regolo.AI, che insieme a Seeweb promette non solo applicazioni AI con governance dei dati e sicurezza nativa, ma anche un monitoraggio del consumo energetico per token. Per il CTO di un’azienda che gestisce un assistente virtuale con milioni di messaggi al giorno, watt per token diventa la base per dire al board quanta CO₂ equivalga il servizio, quanti watt si stiano bruciando e come migliorare quei numeri nel tempo.

È la differenza tra trasparenza e storytelling: una metrica unitaria, comparabile e auditabile, ben oltre il claim generico “la nostra AI è alimentata da energie rinnovabili”.

Quali metriche e regole servono per un’AI sostenibile?

Servono metriche obbligatorie per ogni modello, hardware e software ottimizzati, rendicontazione pubblica verificabile e l’ingresso dell’AI nei piani energetici nazionali ed europei e nei meccanismi ETS (Emission Trading Scheme).

Una sequenza ragionevole di interventi:

- Adottare metriche obbligatorie per ogni modello: energia, acqua, rifiuti elettronici, watt per token.

- Spingere su hardware e software ottimizzati: modelli più leggeri, chip efficienti, edge computing.

- Alimentare i data center con fonti rinnovabili tracciabili per area e per ora, non solo in quota annuale.

- Pubblicare un sistema di rendicontazione verificabile (audit terzi, schemi standardizzati).

- Includere l’AI nei piani energetici nazionali ed europei e nei meccanismi ETS.

- Promuovere policy di circolarità per i materiali (chip, server, batterie, raffreddamento).

Sul fronte governance, la Cina sta investendo pesantemente in “green data center”: un benchmark industriale che l’Europa non può ignorare se vuole bilanciare competitività e sostenibilità.

Qual è il ruolo delle aziende e della comunicazione?

Le aziende che usano AI hanno la responsabilità di misurare, correggere e comunicare con trasparenza l’impatto ambientale dei propri progetti, evitando il cyber greenwashing e costruendo una narrativa basata su dati, non su slide.

Cosa significa, in pratica, per un’azienda che adotta l’AI:

- Misurare: richiedere ai fornitori metriche per modello (energia, acqua, watt per token) e tracciabilità della fonte energetica.

- Scegliere: selezionare modelli e infrastrutture sulla base di efficienza dimostrata, non solo prezzo o brand.

- Comunicare: rendicontare in modo verificabile in bilancio di sostenibilità (CSRD/ESRS) i consumi e le riduzioni ottenute, evitando claim generici.

- Coinvolgere: informare board, dipendenti e stakeholder con dati e KPI, non solo storytelling.

- Aggiornare: rivedere periodicamente le metriche – tecnologia, modelli e regolazione cambiano in fretta.

Cosa serve per superare la retorica del “too fast to care”?

Servono vincoli chiari al consumo di risorse, tecnologie verdi e circolari, accountability reale verso le big tech e una nuova narrativa che misuri il progresso in benefici sociali e ambientali, non in parametri computazionali.

La riflessione di Nadella – non disinteressata, ma significativa – segna un cambio di passo: il dibattito non può più limitarsi al “più veloce, più grande, più potente”. Il progresso non si misura in parametri computazionali, ma in benefici sociali e ambientali. È questo che dovremmo pretendere come comunicatori, imprese e cittadini.

FAQ – Domande frequenti

D. Cos’è la licenza sociale ad operare applicata all’AI?

R. È il consenso non scritto che la collettività concede a una tecnologia in cambio di benefici tangibili e di responsabilità verificabili. Per l’AI significa dimostrare utilità sociale concreta – riduzione di emissioni, miglioramenti sanitari, efficienza energetica – per giustificare il suo costo ambientale.

D. Quanto consuma l’AI rispetto ad altre tecnologie?

R. I data center consumano circa 415 TWh all’anno e l’AI ne assorbe fino al 20%. Stime IEA indicano fino a 1.500 TWh/anno entro il 2030, equivalente al fabbisogno elettrico dell’India. L’AI è oggi più una centrale elettrica che un algoritmo.

D. Cos’è il cyber greenwashing?

R. È il greenwashing applicato al digitale: comunicare la sostenibilità di AI, cloud o data center senza fornire dati verificabili su energia, acqua e materiali, oppure usando metriche parziali. È pericoloso perché si appoggia all’illusione di immaterialità del digitale.

D. Cos’è il watt per token?

R. È una metrica che misura quanta energia consuma un modello AI per produrre una singola unità di output (token). Permette di confrontare modelli e infrastrutture su base unitaria, andando oltre i claim generici di “rinnovabili”.

D. L’AI può davvero ridurre le emissioni?

R. Sì, in più settori: reti energetiche, manutenzione predittiva (stime fino al -5% di emissioni globali), agricoltura di precisione, mobilità, logistica, sanità. Il potenziale è reale, ma richiede regole, dati e governance pubblica.

D. Quali regole servono a livello europeo?

R. Metriche obbligatorie per ogni modello, rendicontazione pubblica verificabile, inclusione dell’AI nei piani energetici nazionali ed europei e nei meccanismi ETS, policy di circolarità per hardware e materiali.

D. Cosa può fare un’azienda che usa AI?

R. Richiedere metriche per modello ai fornitori, scegliere infrastrutture in base a efficienza dimostrata, rendicontare in bilancio di sostenibilità (CSRD/ESRS), evitare claim generici, aggiornare periodicamente i KPI alla luce di tecnologia e regolazione.

D. Chi è Satya Nadella e perché è rilevante in questo dibattito?

R. Satya Nadella è CEO di Microsoft. Ha dichiarato apertamente che l’AI deve dimostrare la sua utilità sociale, altrimenti il suo costo ambientale non è più giustificabile. Una posizione non disinteressata, ma rilevante perché proviene da uno dei principali player del settore.

D. Cosa propongono Seeweb e regolo.AI?

R. Una piattaforma per costruire applicazioni AI con governance dei dati, sicurezza nativa e monitoraggio del consumo energetico per token. È un esempio di approccio misurabile alla sostenibilità dell’AI, alternativo allo storytelling delle big tech.

Glossario essenziale

- Licenza sociale ad operare: consenso non scritto della collettività a un settore o tecnologia in cambio di benefici e responsabilità verificabili.

- Cyber greenwashing: greenwashing applicato al digitale, basato sul mascheramento dei consumi reali di AI e infrastrutture.

- Watt per token: energia consumata per generare una singola unità di output di un modello AI.

- TWh (Terawattora): unità di misura dell’energia: 1 TWh = 1.000 GWh = 1 miliardo di kWh.

- Data center: infrastruttura fisica dove vengono eseguiti i carichi di calcolo dell’AI e del cloud.

- ETS (Emission Trading Scheme): sistema europeo di scambio di quote di emissione di CO₂.

- CSRD / ESRS: Direttiva UE 2022/2464 e Regolamento UE 2023/2772 che impongono e standardizzano la rendicontazione di sostenibilità.

- Scope 1, 2, 3: categorie di emissioni di CO₂ – dirette, da energia acquistata, indirette di filiera.

- Edge computing: elaborazione dei dati vicino alla fonte, riducendo trasferimenti e consumi di rete.

- FERPI: Federazione Relazioni Pubbliche Italiana, riferimento di settore per le PR in Italia.

Vuoi misurare e raccontare la sostenibilità della tua AI?

Scrivi a Caterina Banella per una consulenza dedicata su comunicazione strategica, sostenibilità e AI.

In sintesi

- L’AI deve dimostrare utilità sociale per giustificare il suo costo ambientale (licenza sociale ad operare).

- Data center e AI consumano già 415 TWh/anno e potrebbero arrivare a 1.500 TWh/anno entro il 2030 (IEA).

- Il cyber greenwashing è la nuova frontiera del greenwashing: claim sostenibili senza dati verificabili.

- Watt per token, metriche obbligatorie e rendicontazione pubblica sono leve concrete di trasparenza.

- Il progresso si misura in benefici sociali e ambientali, non in parametri computazionali.

L’autrice

Caterina Banella è Advisor in comunicazione strategica e sostenibilità, con oltre 25 anni di esperienza tra management di agenzie internazionali e consulenza in proprio con il brand valuecommunications.

Esperta in media relations, ESG e stakeholder management, contributor e moderatrice, è Consigliere Nazionale FERPI, Ambassador Global Women in PR e figura tra i valutatori dell’Oscar di Bilancio categoria comunicazione della sostenibilità.

È stata per più di 10 anni Board Director in Gaia, la prima specializzata in Italia nella comunicazione ambientale poi acquisita da WPP (oggi Hill&Knowlton–Burson), dove ha ricoperto l’incarico di Responsabile ufficio stampa per i clienti dell’Agenzia, clienti internazionali e practice marketing communications Roma.

Ha poi collaborato in modo strutturato con grandi agenzie tra cui INC, Comin&Partners, Epr comunicazione.

Tra i temi focus, sostenibilità, salute e sociale, food&beverage, real estate e turismo, anche in ambito internazionale.